AI 互連技術展望:NVIDIA 領航 CPO 與矽光子架構轉型

發佈日期

2026-04-16

更新頻率

不定期

報告格式

NVIDIA 正將 AI 競爭從單點算力推向「系統級互連工程」,透過整合 Fabric 架構與矽光子技術,將高階互連瓶頸由電轉光。其佈局涵蓋 Scale‑Up/Scale‑Out 機櫃架構與共同封裝光學(CPO),旨在解決傳輸功耗與頻寬受限問題,帶動光通訊供應鏈價值重構,確立未來算力基建的核心優勢。

重點摘要

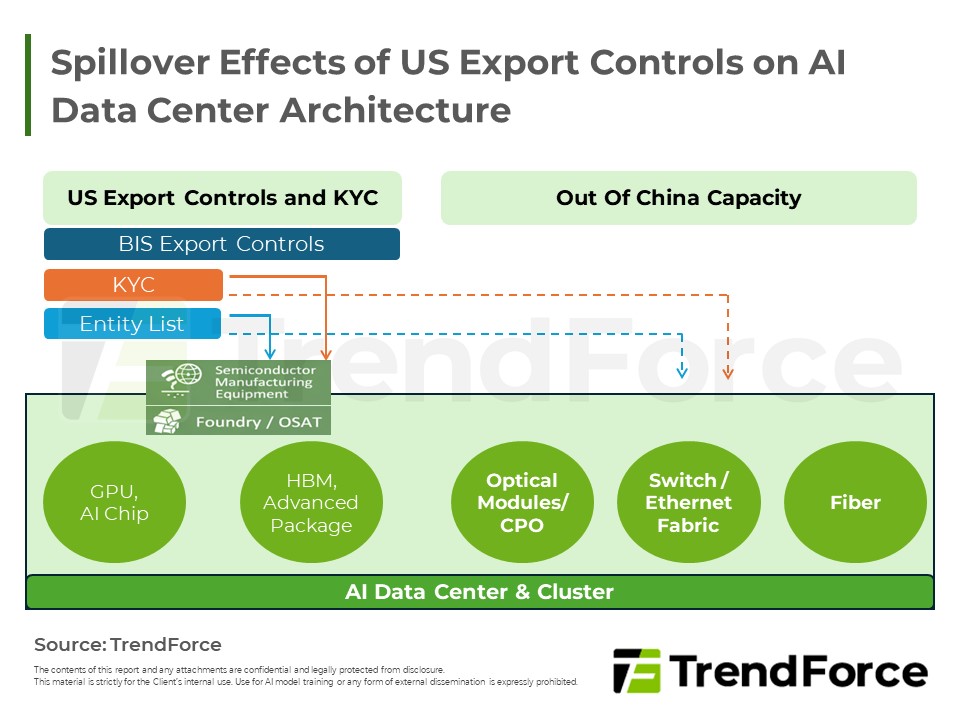

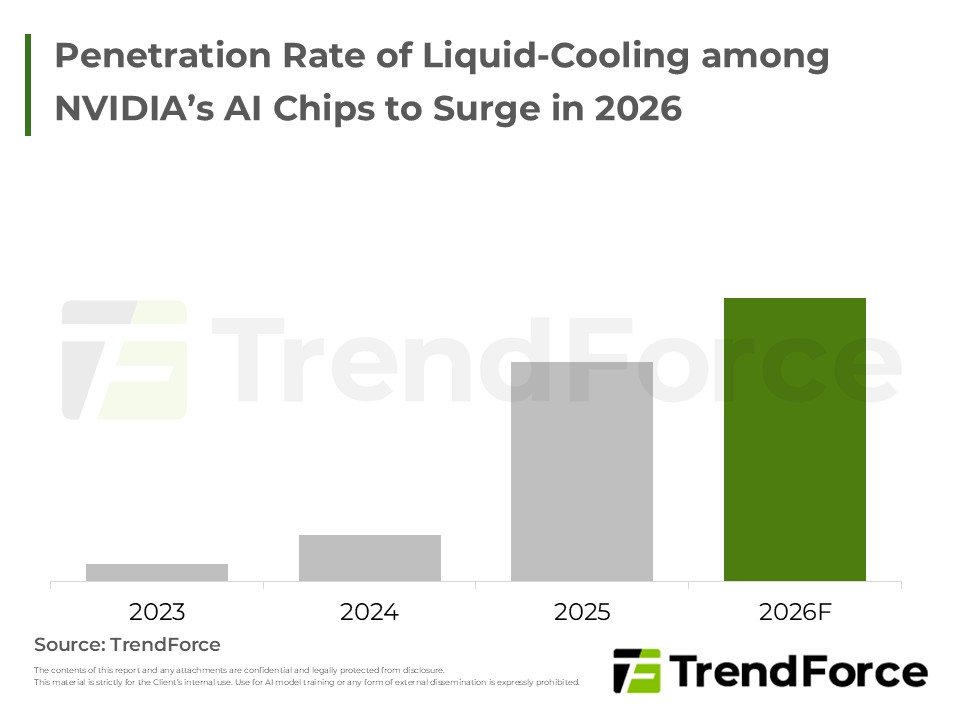

- 算力瓶頸轉移:隨著模型規模擴張,傳輸效能受限於電學走線的功耗與延遲,瓶頸已從晶片算力轉向互連頻寬,推動互連技術從「長銅線」邁向「短電線、輕光學」的轉型。

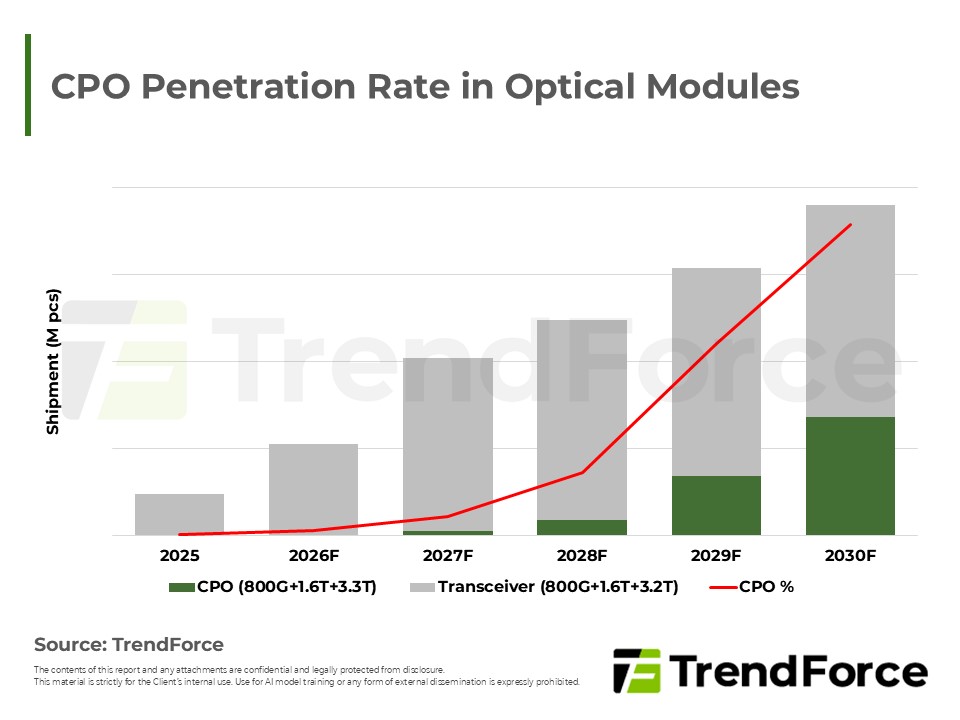

- CPO 技術必然性:共同封裝光學將光引擎與晶片緊鄰配置,顯著降低能源消耗並提升傳輸效能,成為未來維持超高頻寬密度與熱管理平衡的關鍵路徑。

- 系統級架構重構:透過矽光子平台與新型交換器,實現從晶片封裝到機房骨幹的一體化整合,將多顆處理器視為一個共享超大頻寬的整體運算單元。

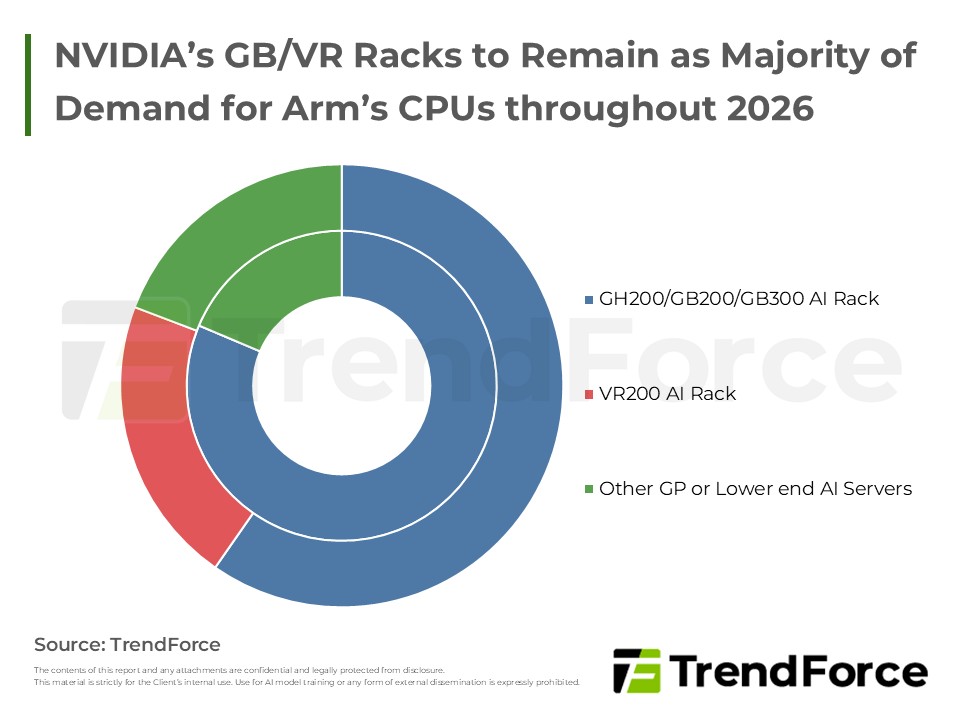

- 市場滲透與展望:預期技術將於新世代機櫃中率先導入,隨封裝工藝成熟,光互連滲透率將在未來數年內大幅提升,帶動相關光學元件與高密度連接器的需求激增。

目錄

- TrendForce’s View

- CPO Penetration Rate in Optical Modules

- NVIDIA Fabric Architecture

- NVIDIA Scale-Out Fabric

- Differences between Pluggable Optical Modules and CPO

- Overview of NVIDIA’s GPU Generations and Rack Interconnect Architectures

- DWDM Photonics For Interconnects

- Example – 200Gbps vs. 32Gbps circuitry

- Optics on Interposer w/ DWDM

- Optics on Interposer

- Spectrum-X Photonics delivers 64x better signal integrity

- Overview of NVIDIA’s Three-Layer Interconnect Architecture

<報告頁數:10>

報告分類: AI/HBM/Server

AI Server 套餐_繁相關報告

下載報告

TWD