2026-2030 NVIDIA AI展望:GPU至LPU整機櫃佈局與推理趨勢

發佈日期

2026-03-17

更新頻率

不定期

報告格式

NVIDIA為防堵雲端廠自研晶片競爭,全面升級AI工廠佈局,推出涵蓋GPU、CPU與LPU的整機櫃方案,雙向通吃訓練與推理市場。透過解耦合架構、光學互連及軟硬體生態系,精準解決能效瓶頸並鞏固霸主地位。

重點摘要

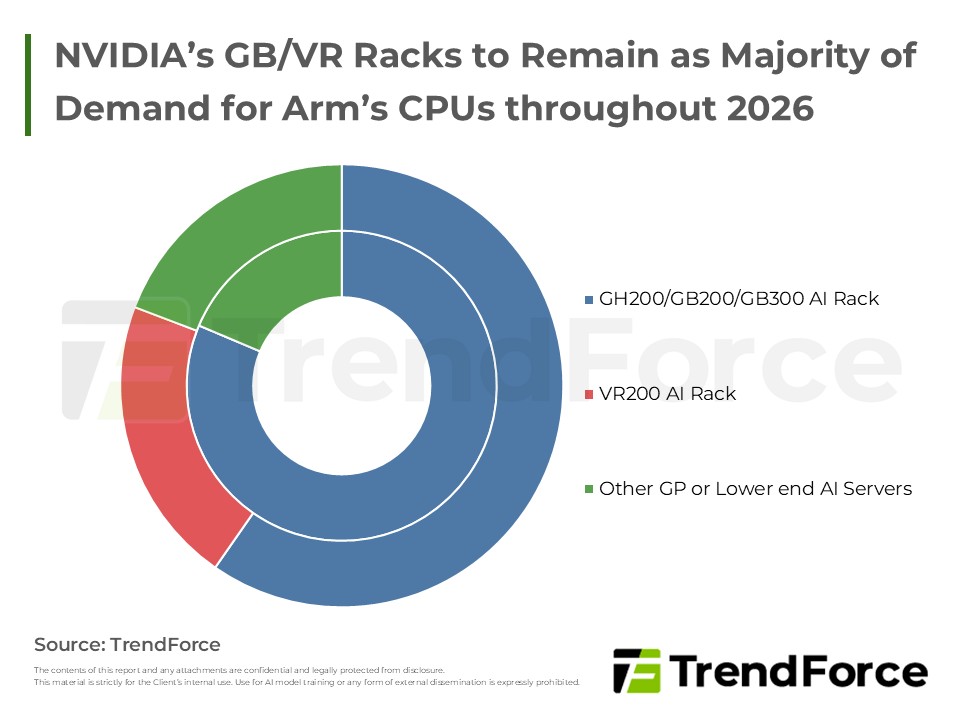

- 硬體多元佈局:從單一晶片走向GPU、CPU及LPU整機櫃高度整合,全面涵蓋AI訓練至低延遲推理需求,強攻代理型AI市場。

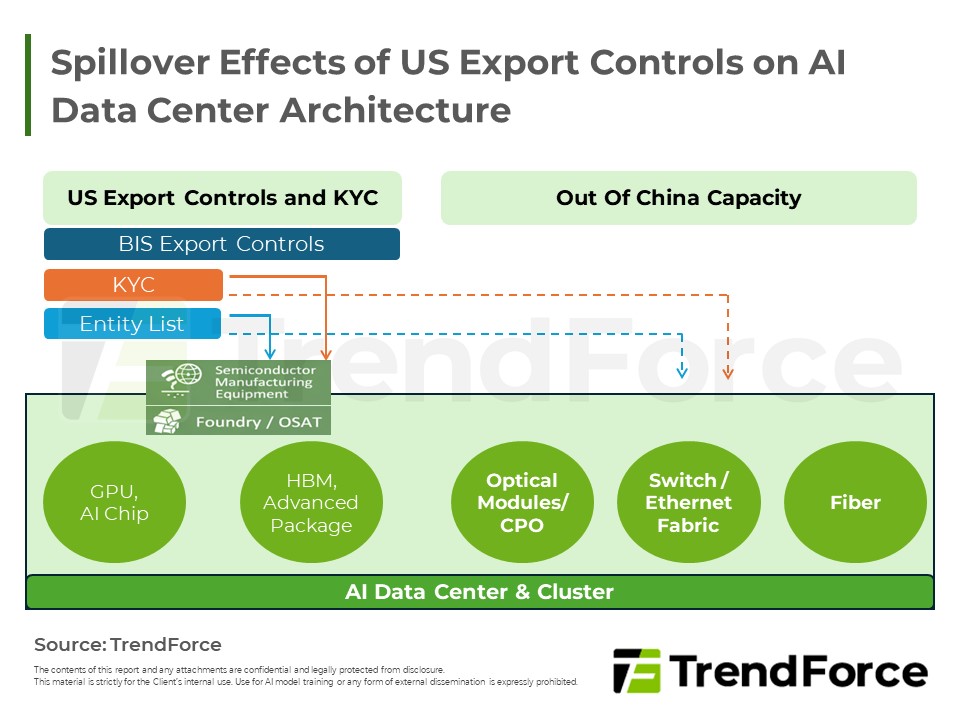

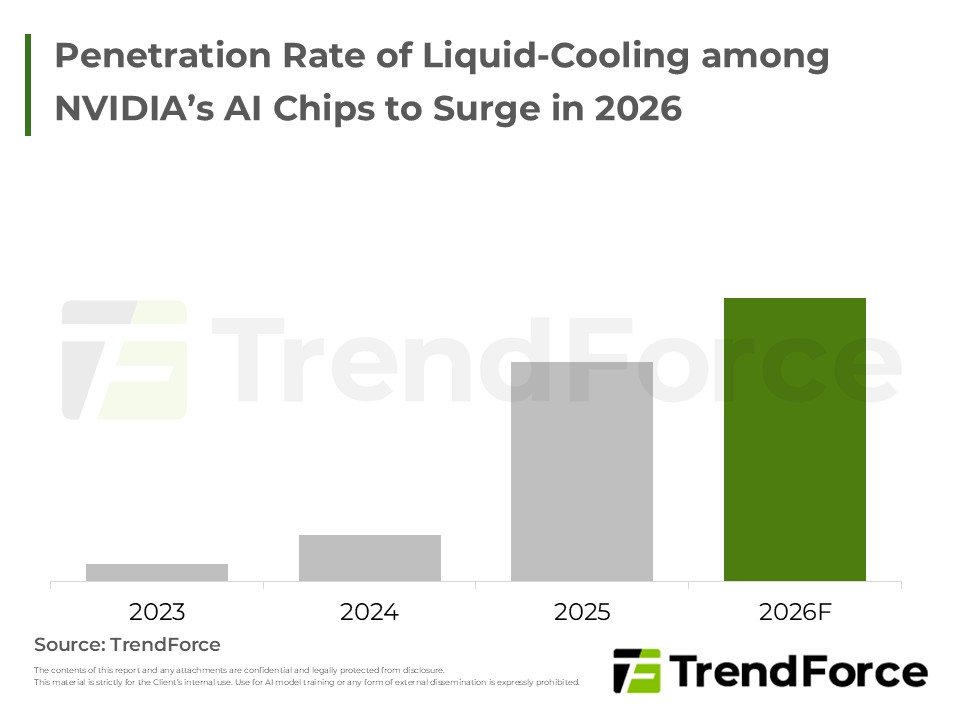

- 架構基建升級:首創「解耦合推理」架構分流運算瓶頸;散熱轉向液冷;連線採銅線與共封裝光學雙軌並行,帶動高階記憶體爆發性需求。

- 穩固市場護城河:面對雲端廠自研晶片威脅,NVIDIA藉由作業系統、網通基建與算力硬體的深度綁定,強化客戶黏著度以捍衛龍頭地位。

目錄

- 前言

- NVIDIA's Product Roadmaps to Segment into GPUs, CPUs, and LPUs when Targeting the AI Market

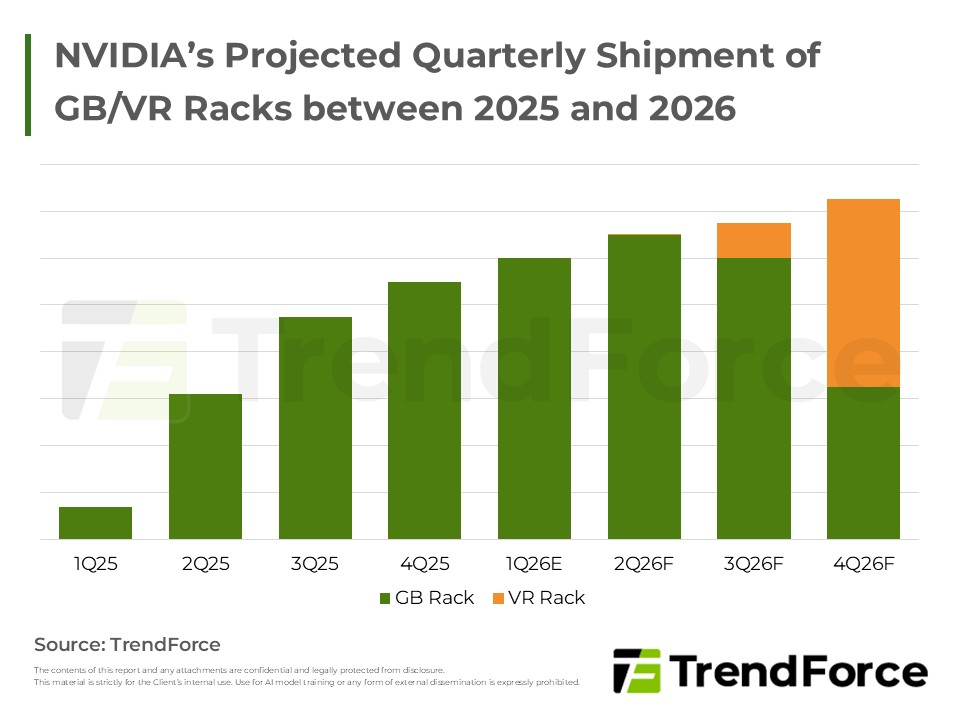

- 預期Vera Rubin Rack型態將於2H26後推出逐步取代GB300市場

- NVIDIA's Projected Quarterly Shipment of GB/VR Racks between 2025 and 2026

- NVIDIA亦提出Vera CPU作為強化Agentic AI基礎設施

- NVIDIA新提出LPU作為AI解耦合推理架構要角

- NVIDIA Introduces Disaggregated Inference LPX Rack Design That Is Distinct from VR Rack

- NVIDIA發展新世代晶片百花齊放將支撐Memory未來成長力道

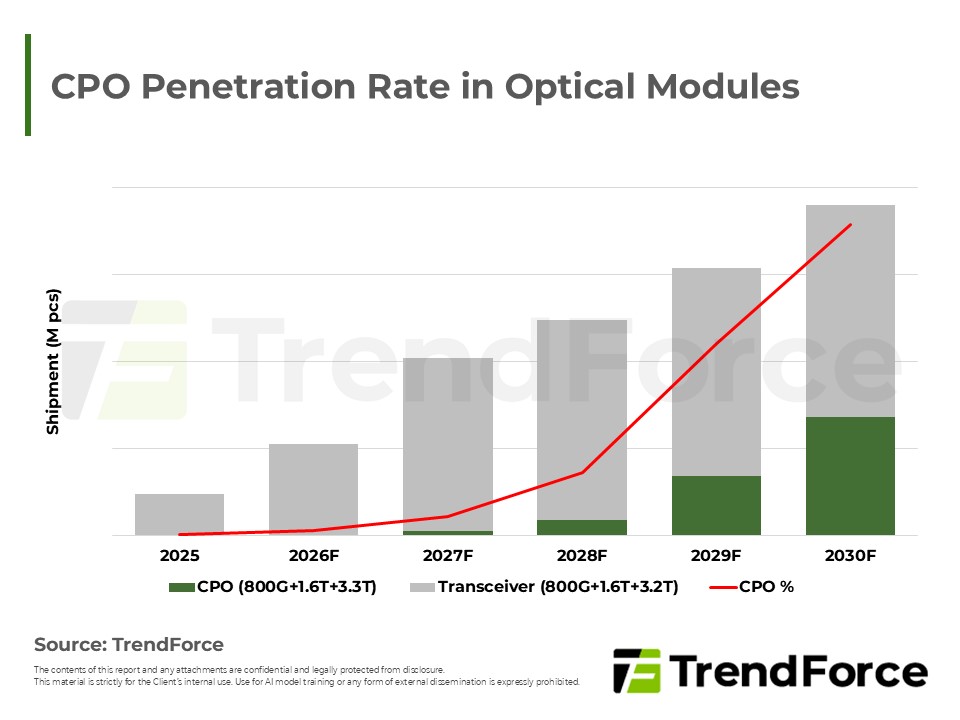

- NVIDIA發展CPO強化整櫃式AI晶片及系統高速互連效能

- Overview of NVIDIA's Chip Generations and Rack Interconnect Architectures

- 小結:面臨CSP ASIC日愈擴大市占挑戰,NVIDIA從CPU、GPU到LPU各面向積極推動整合式Rack型態強化從AI訓練擴及至AI推理應用

<報告頁數:8>

報告分類: AI/HBM/Server